Modele rozumowania to nowa klasa dużych modeli językowych (LLM), które kładą większy nacisk na "myślenie" i "refleksję" nad problemem, zamiast po prostu przetwarzać dane wejściowe. W praktyce oznacza to, że potrafią one lepiej analizować skomplikowane zagadnienia, podawać uzasadnienia swoich decyzji oraz dzielić się logiką rozwiązania problemu.

Kluczowym założeniem tych modeli jest to, że każdy problem można rozwiązać poprzez głęboką analizę i odpowiednie wykorzystanie dostępnej mocy obliczeniowej. Proces ten nazywany jest skalowaniem w czasie testowania (test-time scaling), gdzie model dynamicznie przydziela zasoby obliczeniowe, by skuteczniej rozumieć i analizować zadanie.

Rodzina DeepSeek-R1 powstała na bazie gigantycznego modelu MoE (mixture-of-experts) o 671 miliardach parametrów. Modele MoE składają się z wielu mniejszych modeli-ekspertów, które specjalizują się w rozwiązywaniu różnych typów problemów. DeepSeek optymalizuje ten proces, dzieląc zadania między mniejsze grupy ekspertów, co znaczną poprawia wydajność.

Aby umożliwić działanie modeli na komputerach klasy PC, DeepSeek zastosował proces destylacji, tworząc sześć mniejszych modeli uczniów (od 1,5 do 70 miliardów parametrów), które przejęły zdolności rozumowania głównego modelu. Modele te zostały zoptymalizowane do pracy na komputerach z RTX AI, zapewniając szybkie i wydajne przetwarzanie.

Szybkość wnioskowania (inference speed) jest kluczowym aspektem dla tej klasy modeli. Układy graficzne GeForce RTX 50, wyposażone w piątą generację rdzeni Tensor, wykorzystują architekturę NVIDIA Blackwell – tę samą, która napędza zaawansowane centra danych AI. RTX w pełni przyspiesza DeepSeek, oferując maksymalną wydajność wnioskowania na komputerach osobistych.

Dzięki temu komputery z kartami RTX 50 mogą przetwarzać zaawansowane modele AI z minimalnymi opóźnieniami, bez konieczności łączenia się z internetem, co zapewnia większą prywatność i kontrolę nad danymi.

Platforma RTX AI oferuje najszerszy wybór narzędzi AI, zestawów SDK oraz modeli, udostępniając możliwości DeepSeek-R1 na ponad 100 milionach komputerów RTX AI na całym świecie, w tym tych z układami GeForce RTX 50.

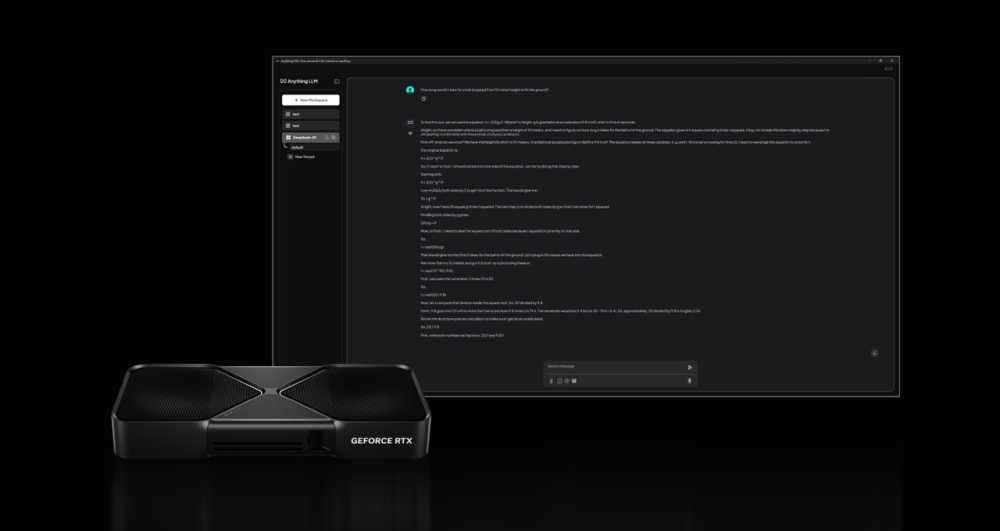

Dzięki temu użytkownicy mogą korzystać z mocy DeepSeek-R1 w popularnych narzędziach AI, takich jak Llama.cpp, Ollama, LM Studio, AnythingLLM, Jan.AI, GPT4All oraz OpenWebUI. Dodatkowo, za pomocą narzędzia Unsloth można dostosowywać modele do własnych potrzeb, wykorzystując dane specyficzne dla danego biznesu.

Dzięki rewolucyjnej technologii modeli rozumowania oraz wydajności kart NVIDIA GeForce RTX 50, komputery osobiste stają się potężnymi narzędziami AI. Nowe modele DeepSeek pozwalają na realizację skomplikowanych zadań, analizowanie danych i automatyzację procesów na niespotykaną dotąd skalę. To kolejny krok w kierunku przyszłości, w której sztuczna inteligencja stanie się integralną częścią naszego codziennego życia.